触觉手套和感知算法

围绕触觉采集、可视化与感知算法的完整方案

这个项目围绕一套自研触觉手套展开,目标是完成触觉数据采集、界面可视化以及物体识别算法设计。整个系统从硬件采集端出发,逐步延伸到数据集构建、实时显示和感知模型验证。

项目概述

我希望让机器不仅能“看到”物体,还能通过触觉信号理解物体的状态与差异。为此,我设计并搭建了一套触觉手套系统,用于采集抓握过程中的压力分布和手指弯曲信息,并进一步结合可视化界面和感知算法完成识别任务。

触觉手套与数据采集

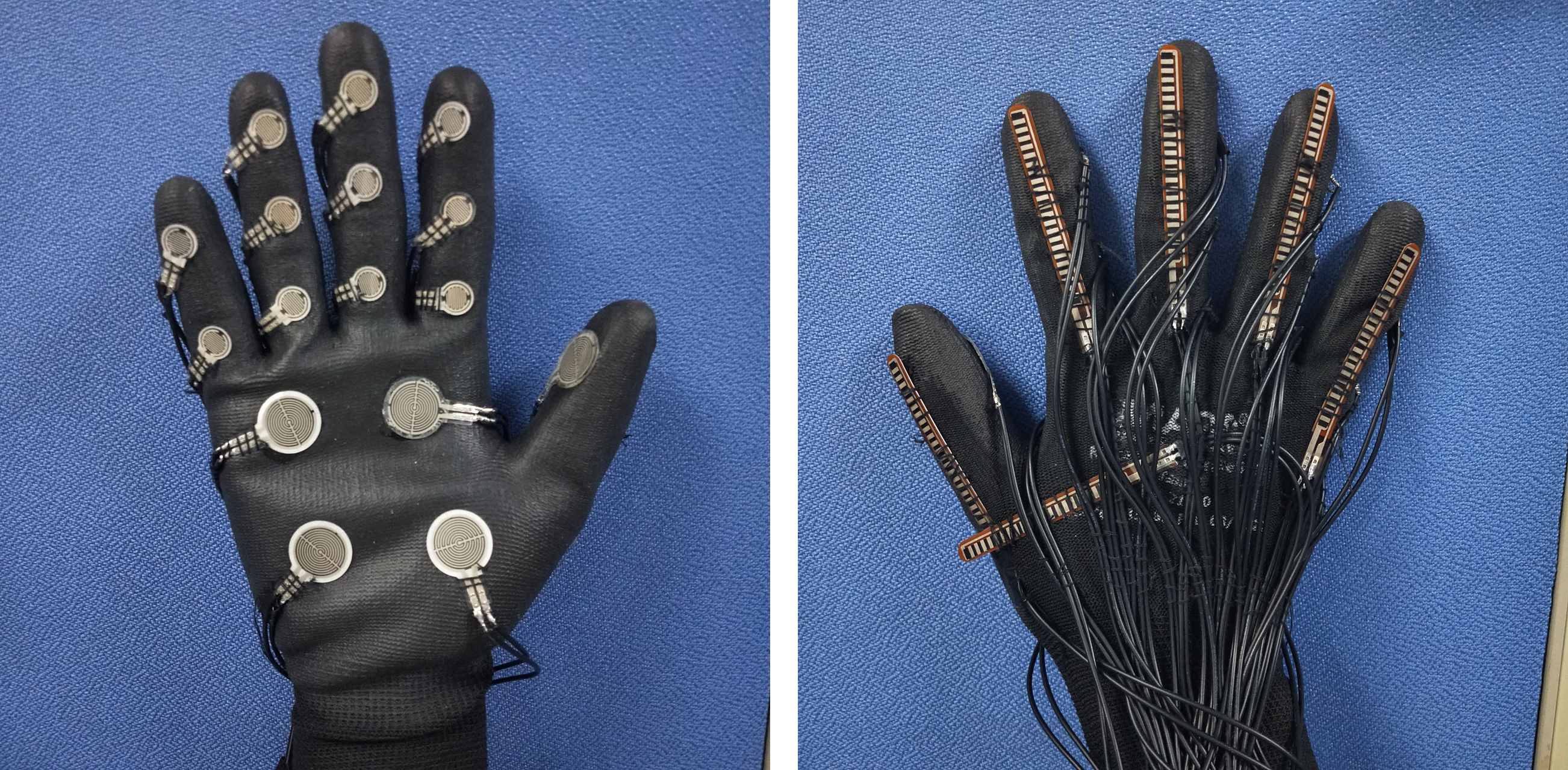

触觉手套由多个压力传感器和弯曲传感器组成,用来同步采集手掌压力分布与手指弯曲状态。通过这套装置,可以稳定记录抓取不同物体时的触觉变化过程,为后续建模提供原始数据。

触觉手套示意图

围绕这套手套,我构建了一个包含多类物体样本的触觉数据集,用于后续识别算法训练与效果验证。

触觉信号采集示意图

可视化界面

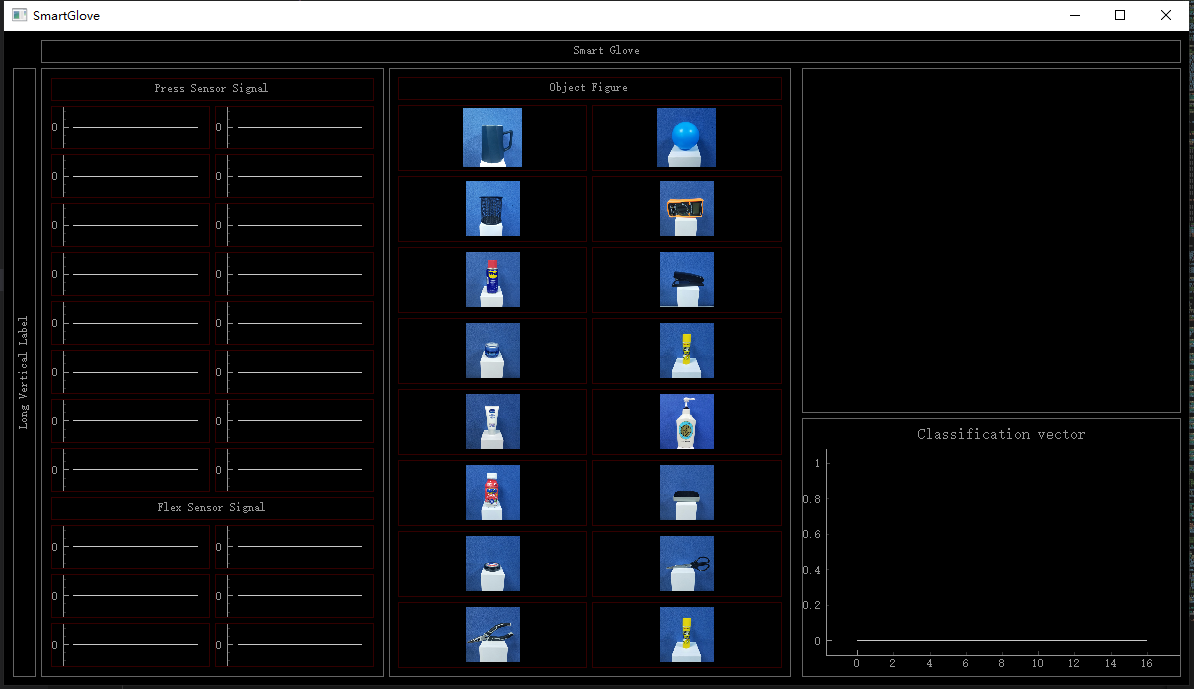

为了便于调试和观察模型输入输出,我使用 pyqtgraph 搭建了一套实时可视化界面。界面左侧显示传感器信号,中间展示触觉样本,右侧给出识别结果与概率分布,方便快速验证采集质量与分类表现。

可视化界面示意图

感知算法设计

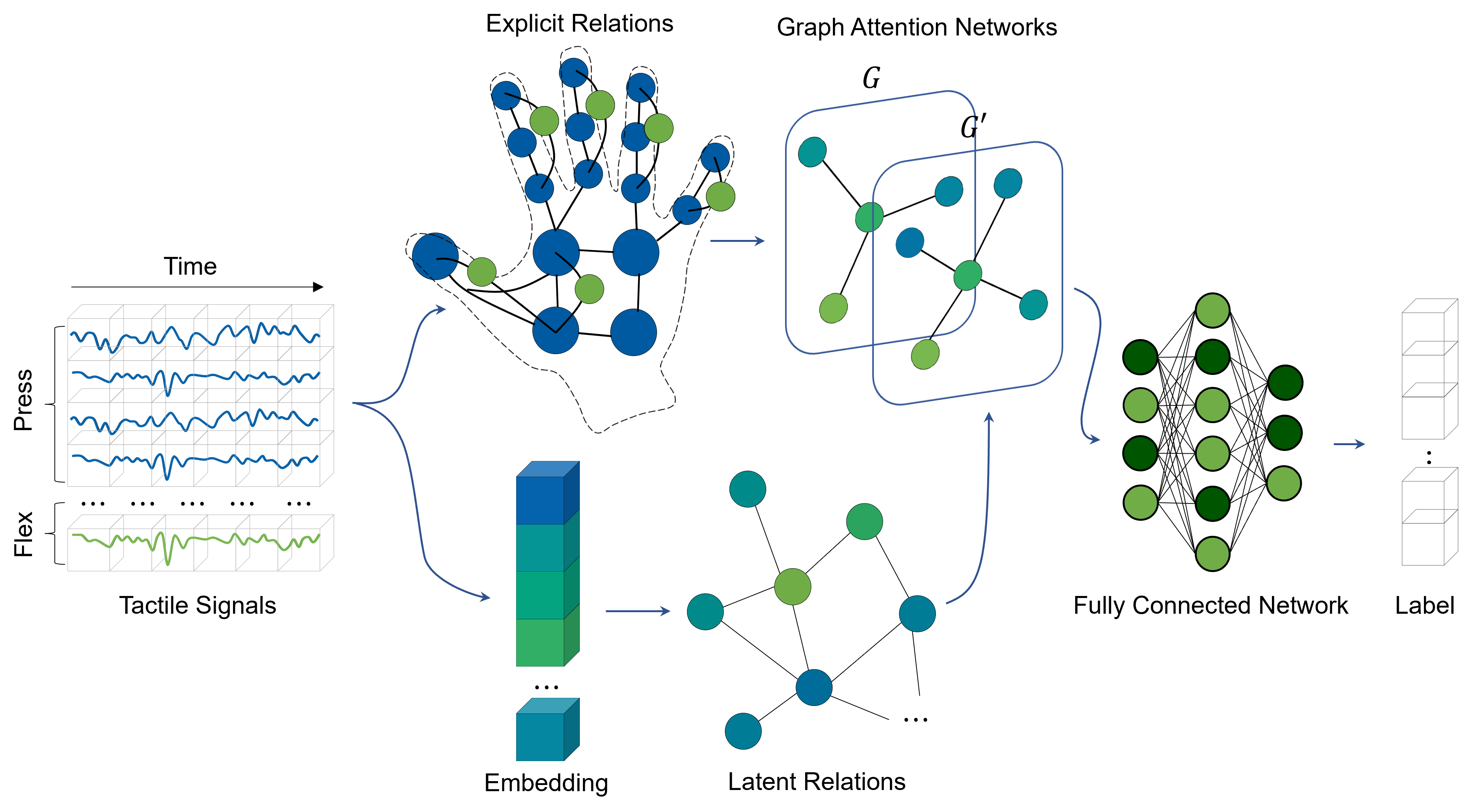

在算法部分,我设计了基于图神经网络的触觉感知模型 Tactile-GAT。模型重点利用不同传感器之间的空间关系来建模触觉分布特征,从而提升对物体类别的识别能力。

Tactile-GAT

演示视频

触觉手套压力采集测试

触觉手套抓握演示视频

项目成果

该项目最终形成了完整的触觉采集与识别方案,并产出了论文与专利相关成果。